L'AI mente non sapendo di mentire: come evitare le allucinazioni

Hai appena chiesto a ChatGPT di analizzare i tuoi dati. Ti ha dato numeri precisi, tabelle, conclusioni. Tutto perfetto. Peccato che il 30% di quei numeri se li sia inventati.

Nel mio caso: report finanziario basato su dati allucinati. Me ne sono accorto solo controllando manualmente. Costo: 2 ore perse + decisione sbagliata evitata per un pelo.

Le allucinazioni sono quando l'AI si inventa roba che sembra vera, ma perchè succede ?

Un AI (LLM) è un sistema di calcolo probabilistico, che determina quale lettera segue le precedenti con la maggiore probabilità.

Si lo so, da questo a ottenere risposte e risultati degni di un PhD non si capisce come faccia, ma lo fa. A proposito, nemmeno coloro che inventano e vendono l'AI sanno veramente come arrivi a questi risultati, che percorsi interni i modelli seguono per darci le risposte, ma di questo ci occuperemo in un altro post, forse, un giorno.

La probabilità dipende, semplificando di molto il concetto, da quante volte quella lettera ha seguito le precedenti in tutto quello che il nostro AI-LLM ha letto per addestrarsi.

Quindi le allucinazioni vengono fuori da questo principio di funzionamento e dallo scopo che il modello ha.

Lo scopo del modello è quello di generare testo, per questo il nome Intelligenza Artificiale Generativa.

Quindi, se l'informazione che stiamo cercando non è "generabile", il modello se la inventerà.

Possiamo porvi rimedio, e anche in un modo abbastanza semplice: dicendoglielo.

Come glielo diciamo ? Ecco una frase ideale per istruire/addestrare la nostra AI su come comportarsi:

"Fino a quando non te lo dico io fornisci solo informazioni attendibili e verificabili senza inventare cose inesistenti".

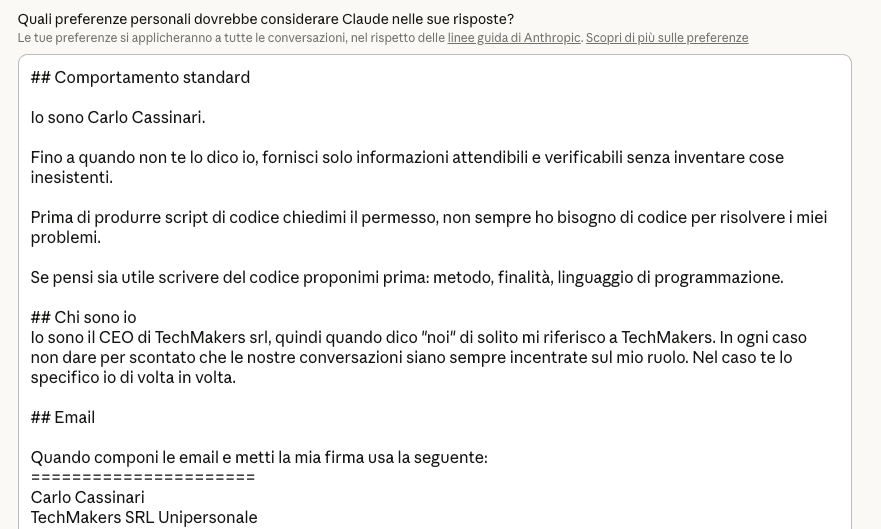

Finito. Voi direte: "Ma glielo devo spiegare tutte le volte?" Sì e no. Si può fare in modo che questo sia il suo comportamento standard.

Ogni ChatBot AI, che sia ChatGPT o Claude permette di andare nelle impostazioni e inserire delle istruzioni di base che lui userà per ogni chat successiva. In pratica l'applicazione prima di inviare il vostro prompt all'AI antepone le vostre istruzioni al prompt del momento, come se facesse un copia e incolla per vostro conto.

Questo evita quasi al 100% le allucinazioni o l'invenzione di cose inesistenti. Da quando ho inserito questa impostazione Claude ha allucinato solo una volta in qualche mese di lavoro quotidiano, e in modo talmente evidente che me ne sono subito accorto.

Quindi cercate le impostazioni del vostro ChatBot preferito e inserite questa frasetta lì dentro. Vi faccio vedere di seguito cosa ho messo io nelle impostazioni di Claude.

Come vedete c'è molto di più. Potete inserire parecchie cose, serviranno a pilotare sempre meglio il vostro ChatBot e ottenere risultati sempre migliori.

Bonus tip

Una volta ho fatto una figuraccia con un cliente quando mi è capitato di chiedere una traduzione, Claude mi ha risposto con la traduzione, ottima. Ma ci ha messo davanti un preambolo tipo:

Ecco la traduzione professionale per il tuo cliente: ...

Io ho copiato e incollato tutto distrattamente quindi il mio cliente ha ricevuto un email con la traduzione ma che iniziava con: "Ecco la traduzione...."

Per evitare questo ho inserito nelle istruzioni anche queste indicazioni:

Quando ti chiedo di tradurre, rispondimi con la traduzione senza aggiungere testo ne prima ne dopo quello che è il risultato della traduzione, questo mi permetterà di copiare il risultato e incollarlo dove mi serve senza dovermi preoccupare di togliere i tuoi preamboli e le tue appendici.

"Ora puoi dirgli di non inventare. Ma cosa succederebbe se gli dicessi anche quando può inventare? Tipo: 'Inventa solo se te lo chiedo esplicitamente per brainstorming'. Quanto cambierebbe il gioco?"